L'intelligenza artificiale sta rivoluzionando il mondo della tecnologia, ma non senza sollevare preoccupazioni sulla sua sostenibilità a lungo termine. Un recente studio pubblicato su Nature mette in luce i rischi del cosiddetto "collasso dei modelli" nei sistemi di IA generativa.

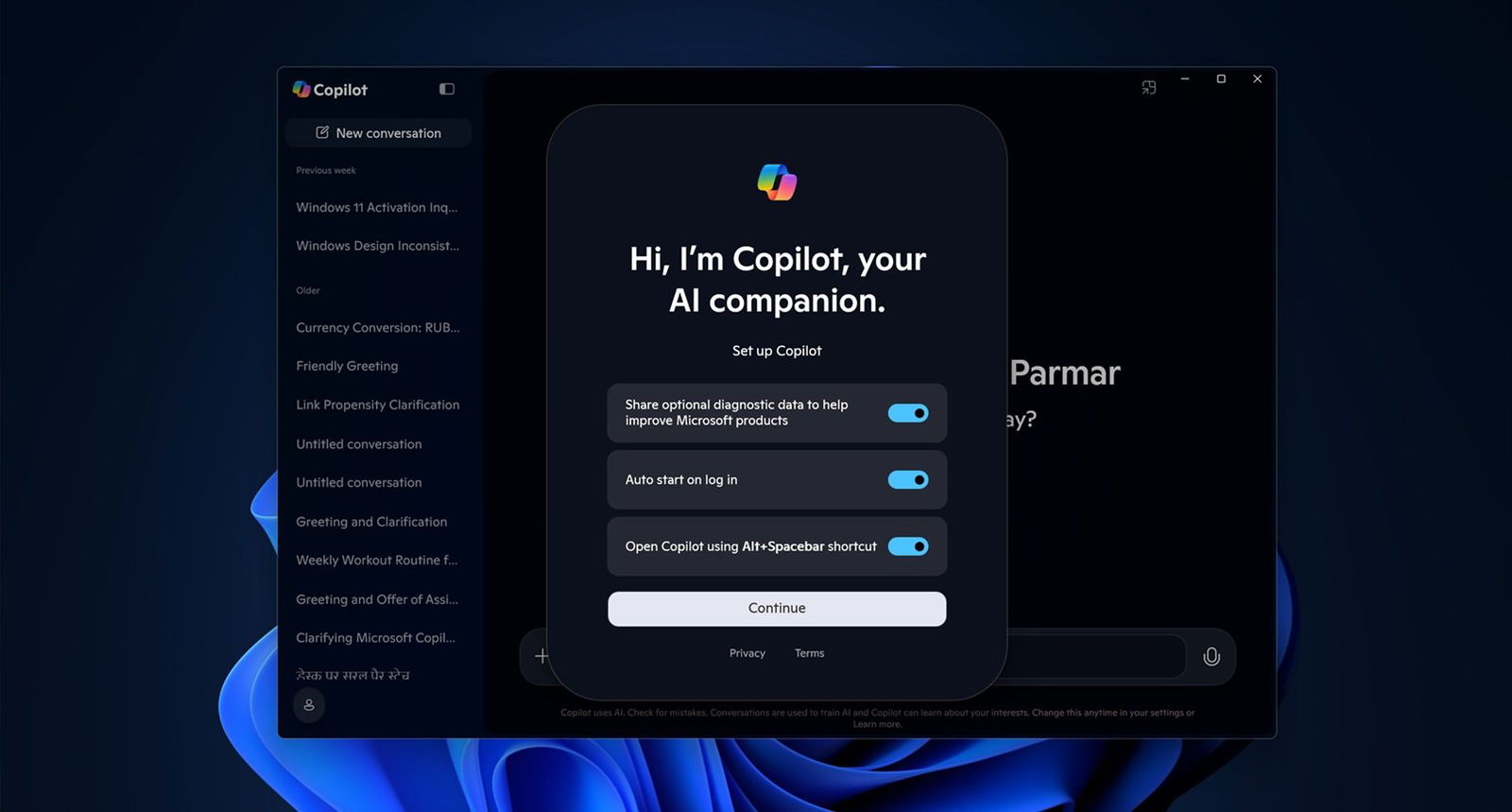

I giganti tech come Microsoft, Google e Meta stanno investendo pesantemente nello sviluppo di modelli linguistici di grandi dimensioni (LLM) e strumenti di IA generativa come ChatGPT, Microsoft Copilot e Google Gemini. Questi sistemi promettono di trasformare radicalmente il nostro rapporto con la tecnologia.

Tuttavia, gli elevati costi di funzionamento stanno mettendo a dura prova anche aziende leader come OpenAI, che affronterà un altro anno in perdita, pur avendo aumentato notevolmente i suoi profitti.

Allo stesso tempo, i colossi tech faticano a monetizzare efficacemente queste tecnologie, dato che il grande pubblico non sembra ancora disposto a pagare per molti degli strumenti attualmente disponibili.

Il fenomeno del "collasso dei modelli", però, è un concetto completamente diverso, secondo il quale, man mano che aumenta la quantità di contenuti generati dall'IA sul web, i sistemi di IA potrebbero iniziare a "nutrirsi" prevalentemente di dati creati da loro stessi per il loro addestramento, con un effetto simile all'endogamia.

Lo studio pubblicato su Nature conferma che l'uso indiscriminato di contenuti generati da modelli nell'addestramento causa difetti irreversibili nei modelli risultanti, con la scomparsa di parti della distribuzione originale dei contenuti.

Gli autori della ricerca sottolineano che questo fenomeno deve essere preso sul serio se si vogliono mantenere i benefici dell'addestramento su dati su larga scala prelevati dal web. In futuro, i dati relativi a genuine interazioni umane con i sistemi acquisiranno sempre più valore rispetto ai contenuti generati da LLM.

La frenetica competizione per capitalizzare su questa presunta rivoluzione computazionale sta portando i giganti tech a muoversi in modo poco responsabile.

Google ha rilasciato prematuramente le sue ricerche basate su IA, con risultati a volte ridicoli. Microsoft ha dovuto fare marcia indietro sulla funzione "Recall" di Copilot a causa di gravi problemi.

Inoltre, l'impatto ambientale dei data center necessari per l'IA sta mettendo a rischio gli impegni climatici di queste aziende. Microsoft ha persino licenziato il team dedicato all'etica dell'IA, segnalando una scarsa attenzione per le implicazioni etiche di queste tecnologie.

Le azioni di queste aziende sembrano guidate principalmente dall'avidità e dall'irresponsabilità. È improbabile che prendano sul serio gli avvertimenti sul "collasso dei modelli", dato che si tratta di un problema che si manifesterà solo in futuro.

Microsoft e Google stanno cercando aggressivamente modi per sottrarre introiti ai creatori di contenuti, incorporando direttamente le informazioni nei risultati di ricerca. Questo rischia di rendere finanziariamente insostenibile la creazione di contenuti per molti, degradando ulteriormente la qualità delle informazioni online e accentuando il potenziale "collasso dei modelli".

Allo stesso tempo, si sta verificando una pericolosa centralizzazione delle informazioni nelle mani di poche potenti entità. È improbabile che i giganti tech prendano seriamente questi rischi o offrano un risarcimento per i contenuti utilizzati per addestrare i loro sistemi di IA.

Se questo trend continuerà, il futuro di Internet potrebbe essere caratterizzato da una progressiva degradazione della qualità dei contenuti e da una sempre maggiore concentrazione del potere informativo nelle mani di pochi attori dominanti.