Un nuovo metodo per individuare le immagini deepfake generate dall'intelligenza artificiale è stato sviluppato dai ricercatori dell'Università di Hull. La tecnica, presentata all'incontro nazionale della Royal Astronomical Society, si basa sull'analisi dei riflessi negli occhi umani.

Il team di ricerca, guidato dalla studentessa Adejumoke Owolabi sotto la supervisione del professor Kevin Pimbblet, ha adattato strumenti astronomici per esaminare la coerenza dei riflessi luminosi negli occhi delle persone ritratte nelle immagini.

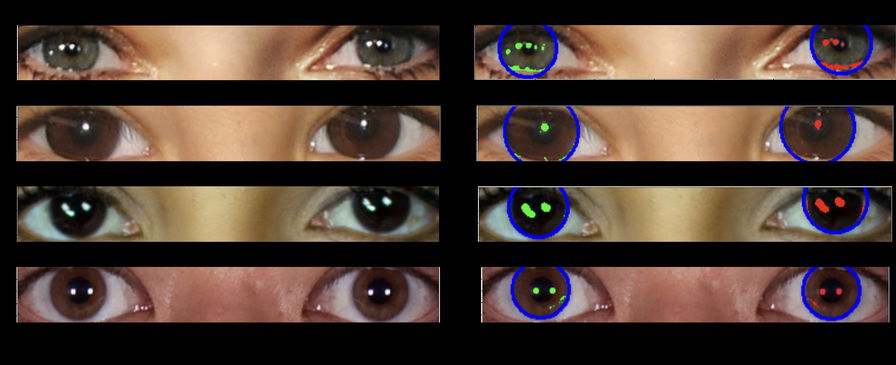

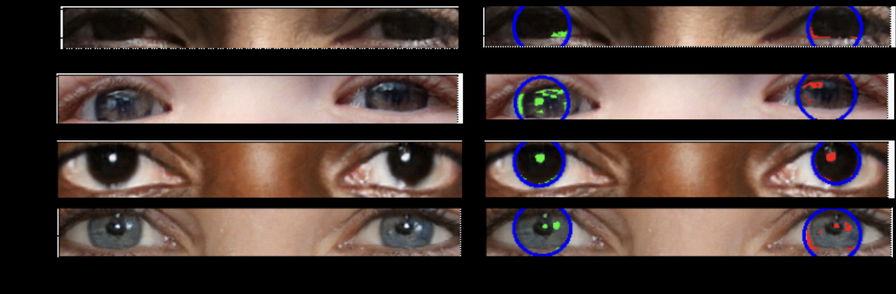

Il principio alla base è semplice: occhi illuminati dalla stessa fonte di luce dovrebbero mostrare riflessi simili in entrambi i bulbi oculari. Tuttavia, molte immagini generate dall'IA non tengono conto di questo dettaglio, producendo riflessi incoerenti tra un occhio e l'altro.

L'astronomia è la chiave

I ricercatori hanno applicato metodi utilizzati in astronomia per quantificare e confrontare i riflessi oculari. In particolare, hanno usato il coefficiente di Gini, solitamente usato per misurare la distribuzione della luce nelle immagini di galassie, per valutare l'uniformità dei riflessi sui pixel degli occhi.

Hanno anche esplorato l'uso dei parametri CAS (concentrazione, asimmetria, uniformità), un altro strumento astronomico per misurare la distribuzione della luce galattica, anche se questo metodo si è rivelato meno efficace nell'identificare gli occhi artificiali.

La tecnica sembra efficace in molte situazioni, ma purtroppo presenta dei limiti. Ad esempio, i ricercatori hanno ammesso che risulta inutile se un modello IA crea riflessi oculare fisicamente accurati, inoltre richiede una visione chiara e ravvicinata degli occhi per essere efficace, infine rischia di produrre falsi positivi, poiché anche le foto autentiche possono talvolta mostrare riflessi oculari incoerenti a causa di condizioni di illuminazione variabili o tecniche di post-elaborazione.

Nonostante questo, la tecnica potrebbe risultare estremamente utile nel rilevare i deepfake se abbinata ad altre, che analizzano fattori come la texture dei capelli, l'anatomia, i dettagli della pelle e la coerenza dello sfondo.

Il professor Pimbblet ha sottolineato che, sebbene la tecnica mostri promesse nel breve termine, non è perfetta. "Ci sono falsi positivi e falsi negativi; non rileverà tutto", ha dichiarato alla Royal Astronomical Society. "Ma questo metodo ci fornisce una base, un piano d'attacco, nella corsa agli armamenti per rilevare i deepfake."