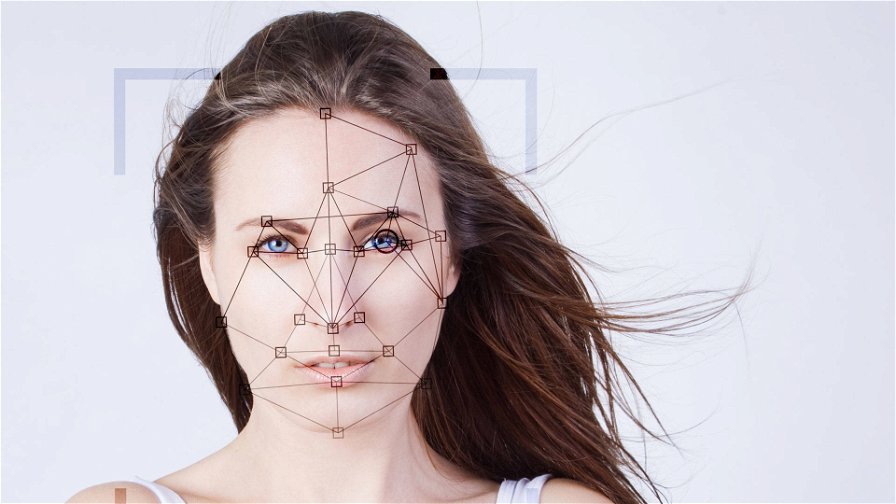

Negli Stati Uniti continua a far discutere la possibilità di utilizzare tecnologie di riconoscimento facciale da parte delle autorità. Così, mentre la decisione di Amazon di concedere la propria soluzione ad alcune forze di Polizia ha fatto sollevare più di qualche mugugno non soltanto alle associazioni di attivisti per i diritti civili ma anche ai dipendenti, in California la città di Oakland si aggiunge a San Francisco e Somerville nel dire no all'impiego di queste tecnologie da parte di autorità e forze dell'ordine.

La decisione, come ha spiegato il sindaco di Oakland, sarebbe stata presa in seguito a uno studio che dimostrerebbe una minor accuratezza di questo tipo di soluzioni per le donne e le persone di colore in generale, sollevando così preoccupazioni sulla discriminazione razziale.

Una convinzione condivisa anche da Luke Stark, docente dell'Università di Harvard, secondo cui il riconoscimento facciale sarebbe "il plutonio dell'intelligenza artificiale: queste tecnologie hanno delle falle insormontabili dovute al modo in cui schematizzano i volti, rinforzando categorizzazioni negative su razza e genere, con effetti sociali tossici. Proprio questi problemi di base fanno sì che i rischi superino enormemente i benefici, in un modo che ricorda il nucleare".

Secondo l'opinione di Domenico Laforenza, direttore dell'Istituto di Informatica e Telematica del Consiglio nazionale delle Ricerche, riportata dall'ANSA, ci sono sì criticità ma bisognerebbe evitare la demonizzazione. "Il principio generale è che la tecnologia non è mai neutra: dipende dall'uso che se ne fa. Questo vale sempre, che si tratti di intelligenza artificiale o di riconoscimento facciale, che ne è una delle applicazioni. Demonizzare un approccio è stupido, se si pensa che la stessa tecnologia può essere d'aiuto per trovare i tumori o per aiutare i medici a fare una diagnosi. Deve essere sotto controllo, regolata per evitare usi distorti".